From Generator to Video Workbench

把这三篇论文放在一起看,指向的是同一件事:视频模型正在从 generator 走向 workbench。 画质、时长和美学依然重要,但已经不足以决定高下。下一阶段真正拉开差距的,是系统能不能在多模态、多约束、带着歧义的人类输入下,稳定地把意图组织出来、执行下去,还不把不该动的部分一起带坏。

UniVideo 解决统一视频系统的骨架,Kling-Omni 解决复杂输入如何进入工作流,Kling-MotionControl 解决统一系统内部在高难任务下如何继续分工。

分界线在移动

视频当然多了一条时间轴,但更麻烦的是,人类意图本来就比 prompt 宽得多。

过去两年,大家谈视频模型,默认是在比生成质量。谁更高清,谁更稳定,谁更像,谁能撑更长时长。这些当然仍然重要,但它们已经越来越不像下一阶段最关键的分界线了。

新的分界线落在一个更具体的问题上:给模型几张参考图、一段参考视频、一句并不那么规整的指令,再加一点局部编辑要求,它到底能不能把这些条件稳稳接住?能不能既保住人物身份,又做对动作或编辑,还不把没让它动的地方一起搞坏?

这也是为什么我越来越不把视频问题理解成“图像问题多了一个时间维度”。时间当然让事情更难,但真正麻烦的是约束会沿时间相互放大。图像里一个局部错误,最多只是别扭;视频里一个局部错误,会在后续帧里连锁扩散。脸漂一帧,身份就开始松;动作乱一帧,时序就开始破;背景改错一块,整段视频的世界观都可能被带崩。

更棘手的是,用户真正想表达的内容,本来就很少能被一句 prompt 说清。很多任务天然带着混合条件:你想让某个人保持这个样子,做那段动作,沿用这张图的光线,再把场景改成黄昏。这里面同时有身份信息、动作信息、风格信息、局部编辑目标和镜头语言。把这些全部压成一句文本,本身就是信息损失。

所以这三篇论文碰到的核心,其实是意图带宽问题。生成质量当然重要,但它更像表层结果。真正决定系统上限的,是它能不能接住足够丰富、足够具体、又足够混杂的人类输入。

沿着“意图带宽”这个角度再看,三篇论文的分工就很清楚了:UniVideo 回答统一系统的骨架怎么搭,Kling-Omni 回答这套骨架怎样变成可工作的创作系统,Kling-MotionControl 则提醒我们,到了角色动画这种深水区,统一系统内部反而更需要精细分工。

UniVideo:骨架先搭对

三篇里,最适合拿来做主线的是 UniVideo。它最像在定义统一视频系统的第一性结构。

三篇里,最适合拿来做主线的是 UniVideo。它最像一篇真正的研究论文:结构判断最清楚,消融也最有价值。

它的基本设计很清楚:把“理解”和“生成”拆成两条流。一条是 MLLM,负责理解文字、图片、视频这些混合输入;另一条是 MMDiT,负责把这些理解变成图像或视频结果;两条流之间再用一个 connector 去对齐。

visual bypass 负责把视觉细节直接送进生成支路。重点看这两条流怎样汇合;接得对,语义、身份和纹理才能一起稳住。

乍看之下,这像一种很自然的模块拼接。但论文没有停在直觉上,而是把三种接法放在一起比了一遍:普通的 cross-attention DiT、带 learnable query 的 cross-attention DiT,以及 UniVideo 用的 MMDiT。结果很清楚:UniVideo 这条 MMDiT 路线,也就是让文本和视频在 self-attention 里一起交互的做法,对齐 MLLM 更稳。它只训练一个 MLP connector 就能跑通,前两种 cross-attention 方案往往还得把生成器一起解冻。

这个结论的分量很大。统一视频模型远不是接一个语言模型当理解器这么简单。难点在于理解流和生成流之间怎样交换信息。接口一旦接得生硬,模型就会落入一种熟悉状态:好像看懂了,但生成不出来;或者语义对了,细节却全散了。

UniVideo 还有一个特别关键的发现:视觉信息不能只给理解支路,生成支路也必须直接看到。很多人直觉上会觉得,既然 MLLM 已经读过图片和视频了,生成器接收压缩后的语义表示就够了。实验结果不是这样。论文消融显示,一旦把视觉输入从 MMDiT 支路拿掉,身份一致性会掉得非常明显。

这其实很好理解。语言模型擅长抽象,擅长抓语义主干;但身份保持、细节对齐、视觉纹理这些事情,很多时候不能只靠抽象后的语义来传。你得把视觉细节直接留在生成链条里。

这也是为什么 UniVideo 在 in-context 生成和编辑上显得特别重要。它最擅长的,是围绕已有参考去生成和编辑;单纯从零开始生成一段视频,反而不是它最突出的部分。给它几张角色图、几个对象、一段视频,再加一条指令,它要把这些条件组织起来,还得保证结果看起来像同一个世界里的东西。

更进一步,UniVideo 还给出一个很实在的信号:多任务联合训练确实有回报。它把 T2V、I2V、图像编辑、视频编辑、带参考生成这些任务一起训练。结果并没有停在“都能做”这一步,很多 in-context 任务都明显更稳,尤其编辑收益很明显。这说明视频模型的很多能力,并不一定要靠等价规模的视频数据才能学出来。图像编辑里学到的指令执行能力,是可以迁到视频里的。

最容易让人兴奋的,是它展示了自由形式视频编辑的泛化能力:模型没有专门在这类视频编辑数据上训练,却能把图像编辑里学到的模式迁到视频里。但现阶段更准确的判断仍然是“路走通了”,还不能说“已经足够稳了”。论文自己也承认,视频编辑的成功率和可靠性还没有达到图像编辑的水平。

Kling-Omni:先翻译意图,再执行意图

它更像一份系统说明书。重点已经从“架构是否成立”转向“用户把复杂输入丢进来以后,系统能不能顺畅工作”。

到了 Kling-Omni,味道就变了。这篇当然也讲模型结构,读起来却更像一份产品系统说明书。关注点也往前推了一步:架构成立只是起点,更关键的是,用户把复杂输入扔进来之后,系统能不能顺着把事做完。

这篇里我最在意的组件叫 Prompt Enhancer。它其实就是一个意图翻译器。

这是我读 Kling-Omni 时最想留下来的洞察之一。很多人默认 prompt 就等于意图本身。可一进真实创作流程,这个等号很快就失效了。用户输入通常非常嘈杂,而且高度分布外。有人写得很抽象,有人把参考图和文本提示混在一起,有人把镜头、风格、动作、局部修改要求揉成一句自然语言。模型直接吃这些输入,效果当然会飘。

Prompt Enhancer 做的事情,就是先把这份高噪声输入整理一遍,翻译成模型更熟悉、也更容易执行的表达。论文里它通过 SFT + RL 去训练,希望输出更准确、更丰富,也更靠近高质量训练数据的分布。

别把这件事只当成前处理。它把一个经常被低估的问题单独拎了出来:输入有没有先被整理成可执行的形式。视频系统的很多能力,输赢往往先发生在这里。换句话说,未来的视频系统很可能越来越像一套分层架构。最上层接住人类输入,中间层负责意图编译,底层生成器再去执行。用户看到的是一个统一接口,系统内部其实在做多层转换。

Kling-Omni 的另一个关键信号,是它很认真地在做身份一致性。论文反复提到 subject library。意思很直接:不要再指望一张参考图解决身份问题。给系统多张同一主体的图,让它看到不同角度、不同表情、不同姿态、不同光线下的样子,这样建立起来的身份表征才更稳。

这几乎已经是基础设施问题了。视频系统一旦进入长时序、多镜头、复杂动作的场景,单张参考图几乎注定会不够。多参考输入不是锦上添花的功能,它正在变成身份保持的基础设施。

这篇还做了很多很工程、但也很硬的事情。比如单独做多模态超分模块补高频细节,比如把采样步数从 150 NFE 压到 10 NFE,大幅降低推理成本,再比如围绕并行、缓存、量化、数据管线做优化。这些内容不如“智能生成”听起来性感,但它们更接近现实。视频模型要从 demo 走向产品,靠的从来不只是模型精度,还靠一整套系统工程。

论文展示了 reasoning-enhanced generation,比如根据视觉标注生成、根据坐标理解场景、做逻辑排序之类的例子。这组例子很容易让人往“模型已经学会推理”上想。但正文写得很清楚:这里接入了更强的视觉语言推理引擎,而且线上版本还没有支持。所以更准确的说法是,这套系统开始具备把外部推理模块接进视频生成链条的能力;这还不能当成“视频模型已经原生学会推理”的证明。

Kling-Omni 更像统一视频系统第一次成熟的产品化尝试。它的价值,在于让人看到一个创作工作台正在成形,也把能力边界说得更清楚了。

Kling-MotionControl:统一系统内部,反而更需要分工

它看起来最垂直,却承担了一个重要的纠偏作用:统一体验,不等于内部结构什么都一样。

Kling-MotionControl 看起来最垂直,它专门讲角色动画。可我读完之后,反而觉得它在三篇里承担了一个很重要的纠偏作用。它让“统一”这两个字变得更真实了。

大家一说统一模型,很容易脑补出一种理想化图景:一个大模型,一套表征,从输入到输出一路贯通,什么都交给端到端学习去解决。角色动画这个问题,恰好很适合打破这种想象。

因为身体、脸和手,本来就不是同一种运动问题。身体动作要的是大尺度结构稳定;面部表情要的是细微变化和局部真实感;手部动作更难,关节细、自由度高,稍微一错就非常扎眼。把它们全压到一种统一表征里,理论上很优雅,实际上很容易互相拖累。

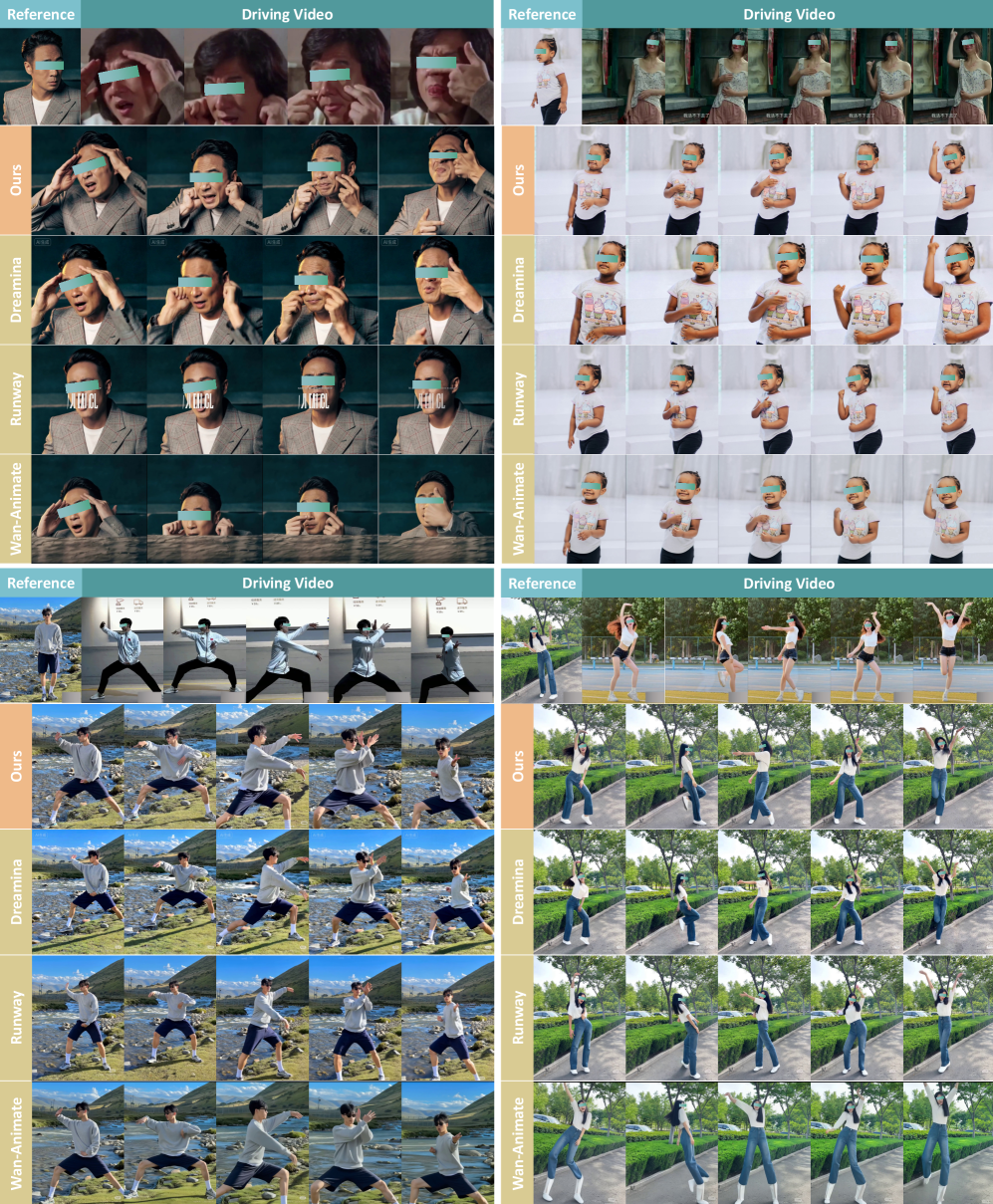

这篇论文把一个关键点讲得很清楚:系统可以统一,运动表征不必统一。 它提出用异构的运动表示去分别处理身体、脸和手,再把这些不同粒度的控制编排到同一个系统里。这看起来像工程拆分,其实是在给统一系统划边界:对用户保持统一体验,对内部保留针对不同难题的分工。

论文里还有两个值得单独记住的点。一个是 identity-agnostic motion learning,也就是身份无关的动作学习。简单说,它想让模型先学会“动作本身”,别把动作死死绑在驱动者的身体比例和外观上。这样它才有机会把一个成年人的动作迁移到小孩、动漫角色,甚至动物身上。

另一个是 semantic motion modeling,也就是动作的语义层。很多动作控制工作看起来都在对齐关键点、骨架和几何结构,但复杂动作往往还带着动作意图。拍手、捂脸、指向某个方向,这些动作如果只学几何,很容易做到形似,做不到神似。

这篇的证据强度比前两篇弱不少。方法细节公开得不够,评测也高度依赖主观偏好,很多强结论暂时还很难审计。所以我更愿意把它当成一个方向上很对的问题定义。离“答案已经讲透”还有一段距离。

但即便如此,它仍然很重要。因为它提醒我们:随着统一视频系统越来越强,真正困难的问题不会消失,只会往系统内部移动。角色动画就是一个非常典型的例子。

把三篇拼起来,收敛路线就很清楚了

这不再像“一个模型做一种任务”的工具箱,而更像一个统一的创作系统正在成形。

单看每篇论文,它们各讲各的。放在一起,路线就出来了。

第一步,是把理解和生成接起来,UniVideo 在做这件事。第二步,是把复杂输入真正组织进一套工作流,Kling-Omni 在做这件事。第三步,是在高难任务上把内部结构继续做深,Kling-MotionControl 在做这件事。

| 论文 | 主要解决什么 | 最关键的动作 | 它真正说明了什么 |

|---|---|---|---|

| UniVideo | 统一视频系统的骨架 | 理解流 / 生成流分离,并保留视觉直达生成支路 | 系统能否稳定执行,首先取决于接口如何组织信息 |

| Kling-Omni | 复杂输入如何进入产品工作流 | Prompt Enhancer + subject library + 工程降本 |

很多“能力”其实长在意图编译和系统工程,不只长在生成器里 |

| Kling-MotionControl | 深水区任务如何继续做稳 | 身体 / 脸 / 手使用异构运动表示 | 统一体验不等于内部同构,真正难的问题会向系统内部迁移 |

三步拼起来,刚好构成下一代视频系统的雏形。它不再是“一个模型做一种任务”的工具箱,而更像一个统一的创作系统。用户给的是混合信号,系统自己完成理解、对齐、任务组合和执行;与此同时,内部又保留足够细的结构分工,避免在高难问题上一锅炖。

这条路线已经带来了几个很明确的变化。第一个,是视频模型的重心正在往 in-context 任务移动。真正有价值的能力,越来越落在后者:围绕给定主体、给定场景、给定上下文去稳定地续、改、组合、迁移。这比单纯凭空生成一段视频更接近真实创作流程。

第二个变化,是很多原来外挂在 pipeline 外面的能力,开始往系统内部回收。参考图、视频编辑、局部修改、风格组合、镜头变化,这些曾经属于不同工具的能力,现在正在被压进同一个接口。

第三个变化,是工作流本身开始变简单。以前用户得自己决定先换脸、再抠图、再改背景、再做风格化。以后系统会越来越多地替用户做任务编排。对于创作来说,这种变化的重要性不亚于模型质量本身。

这条路很有前景,但还不是“世界模型已经来了”

三篇论文让我对方向更有信心,但也让我对夸张叙事更谨慎。

看完这三篇,我对这个方向的信心是上升的,但对很多夸张叙事反而更克制了。今天最能站住的结论,是视频系统正在变得更统一、更可控,也更接近一个真正的工作台。

还不能轻易下的结论也很清楚:系统能接入推理模块,不等于模型已经形成了原生推理能力;出现过几个漂亮的泛化案例,不等于自由形式视频编辑已经足够可靠;多任务统一接口很强,也不代表它在每一个单项任务上都已经赢过最强专家模型。

还有一个常被忽略的边界:用户看到的是统一体验,但背后到底有多少能力来自模型本体,多少来自数据工程、前处理和系统拼装,这些边界仍然需要更清楚地拆开。

我反而觉得,这些边界不会削弱三篇论文的价值,它们只是把战场说得更清楚了。接下来决定上限的,会落在四件更硬的事上:意图翻译是否稳定、身份保持是否可靠、开放编辑是否可复现、推理成本是否降得下来。 画质和美学当然仍然重要,只是它们已经不再构成全部。

谁能同时把这四件事做好,谁才更接近下一代视频基础系统。也正因为如此,我读完之后,对“更大的模型”兴趣反而下降了一点,对“更好的系统结构”兴趣上升了很多。接下来的胜负手,可能不在谁做出了最惊艳的一段 demo,而在谁先把视频模型做成一个真正可工作的创作工作台。

视频模型正在从“会生成内容”走向“会执行创作意图”,而统一视频系统真正的门槛,已经从生成质量转向系统组织能力。

更短一点说:下一代视频模型,会越来越像 workbench。generator 只是它的起点。